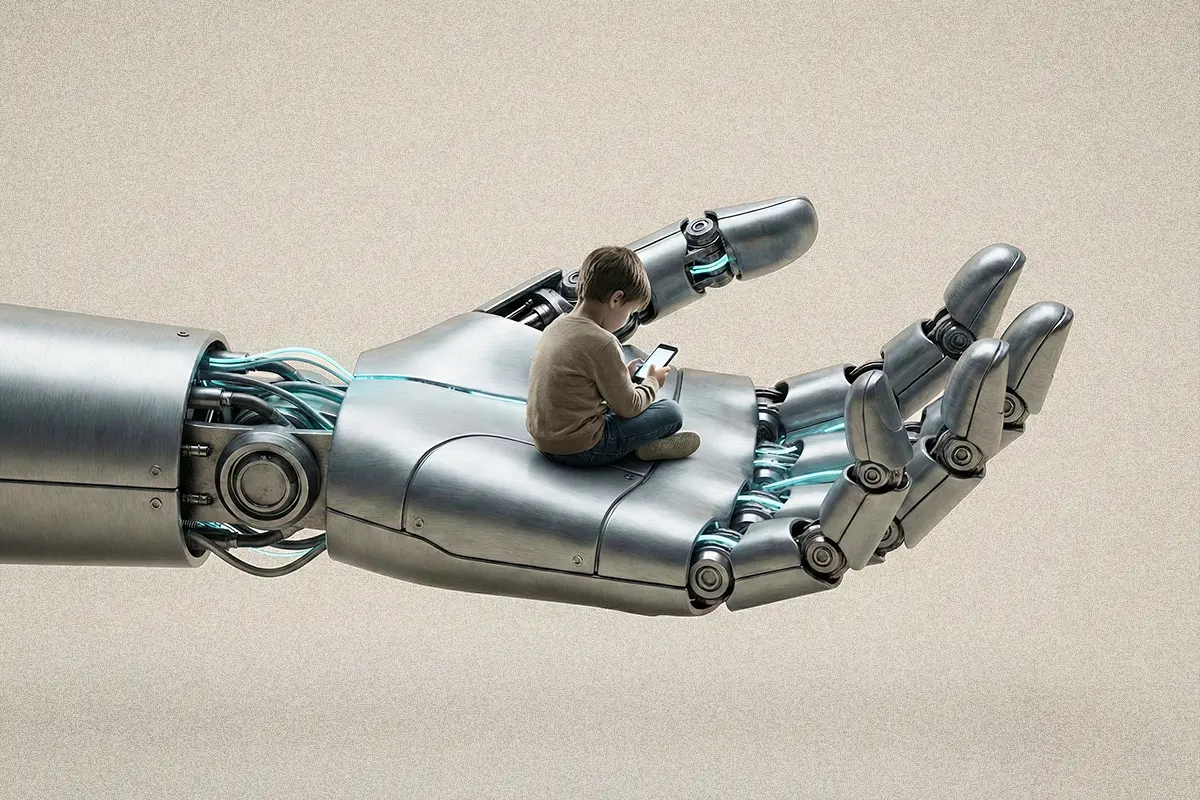

Piden rediseñar IA para proteger a miles de millones de niños

El Post

Lo esencial: La UIT, UNICEF y más de una docena de organismos internacionales lanzaron una declaración conjunta alertando sobre la “urgente necesidad” de rediseñar la inteligencia artificial poniendo en el centro a los más de 2,000 millones de niños y adolescentes del mundo. Pese a su robustez técnica, el documento no tiene carácter obligatorio.

Por qué importa: Aunque la IA ofrece oportunidades “sin precedentes” para la educación y el desarrollo, la mayoría de los sistemas actuales no han sido diseñados pensando en el bienestar infantil, dejando a los menores vulnerables ante tecnologías que no comprenden del todo.

El problema de fondo: Existe un vacío crítico en la gobernanza de la IA respecto a los menores. La declaración insta a los Estados a tomar medidas legislativas inmediatas para que la IA sea gobernada bajo el principio del “interés superior del niño”, evaluando su impacto físico, mental y social antes de ser desplegada.

Los peligros identificados: Los organismos internacionales exigen prohibir y perseguir penalmente nuevas formas de abuso facilitadas por la IA.

- Contenidos generados por IA: Material de abuso sexual infantil creado o modificado algorítmicamente.

- Manipulación emocional: Sistemas de IA que imitan la interacción humana y podrían generar vínculos emocionales “malsanos” en los niños.

- Algoritmos dañinos: Herramientas de recomendación que dirigen a menores hacia contenidos de autolesiones, trastornos alimentarios o desinformación.

- Chatbots como Character.AI fomentan vínculos emocionales dañinos, role-playing sexual y aislamiento. Hay casos graves, incluido un suicidio.

- IA generativa (como ChatGPT) puede exponer a menores a desinformación, violencia o acoso personalizado (grooming), según alerta la ONU.

- Deepfakes y apps de nudificación generan imágenes sexuales falsas de niños, usadas para extorsión.

- Juguetes IA “educativos” fallan: hasta 1 de cada 4 respuestas incluye contenido inseguro.

- Latinoamérica está más expuesta por falta de regulación y control parental. Character.AI ya empezó a restringir a menores tras demandas.

Privacidad por diseño: El informe arremete contra el modelo de negocio digital predominante que “monetiza los datos, la atención y la actividad digital de los niños”. Exige el consentimiento informado de los padres para la recopilación de datos y prohíbe el uso de información personal de menores para entrenar grandes modelos de lenguaje sin autorización explícita.

El plan de acción: La declaración presenta recomendaciones clave para proteger a los menores en la era digital.

- Justicia adaptada: Crear recursos efectivos para que los niños puedan denunciar violaciones de sus derechos cometidas por sistemas de IA.

- Inclusión total: Garantizar que la IA sea accesible para niños con discapacidad y en zonas rurales, eliminando los sesgos algorítmicos de raza o género.

- Supervisión humana: Asegurar que en contextos sensibles como el militar o el educativo, el juicio humano siga siendo fundamental frente a la toma de decisiones automatizada

Qué dicen: “Los rápidos avances de la IA están cambiando radicalmente el mundo de las generaciones presentes y futuras”, señala el documento. Los firmantes concluyen: “Nosotros, las partes firmantes, instamos a las empresas y a la sociedad civil a garantizar que la IA sea diseñada, desarrollada y gobernada de manera que se respeten y promuevan los derechos del niño”.

Sí, pero: A pesar de marcar “un antes y un después en la regulación tecnológica global” según el documento, la declaración conjunta no es una resolución. Por tanto, ningún gobierno está obligado a implementarlo, lo que podría limitar su impacto real en la protección de los menores.